新东西太多了,一点点写

很有用的实践性很强的基于Pytorch的深度学习入门教程

准备阶段

三个小概念

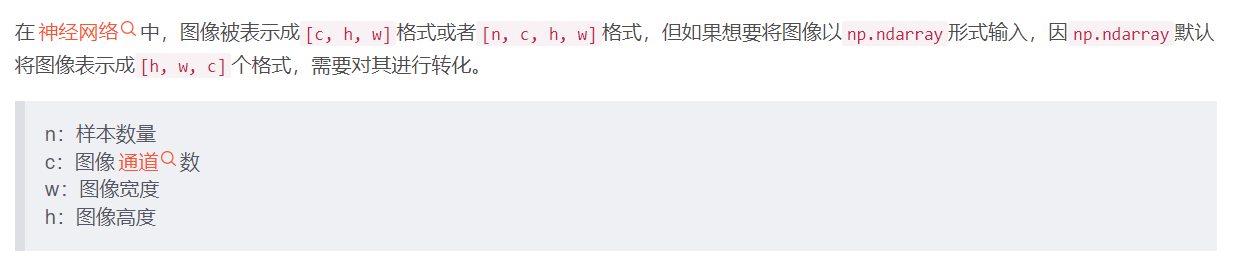

图像通道表示

shape为[w, h, c]的nump.ndarray或img

shape为[c, w, h]的Tensor

参考文章:np.ndarray的[w, h, c]转为Tensor的[c, w, h]

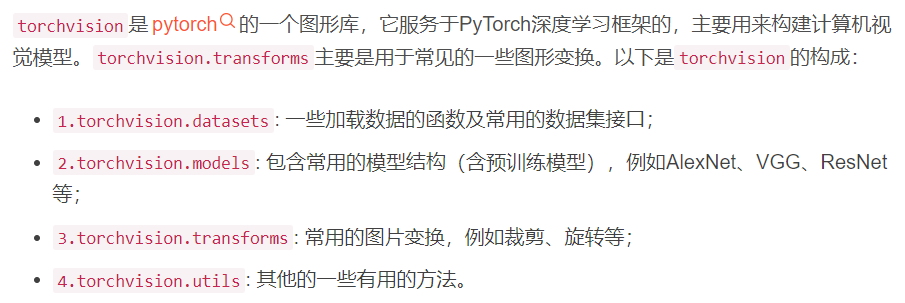

torchvision

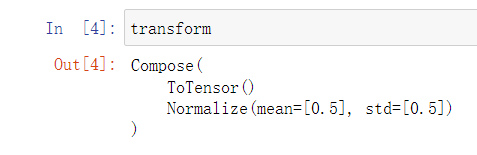

torchvision.transforms.Compose()类,其主要作用是主要作用是串联多个图片变换的操作,Compose里面的参数实际上就是个列表,而这个列表里面的元素就是你想要执行的transform操作下面的语句表示这个串联操作会先执行

torchvision.transforms.ToTensor(),再执行torchvision.transforms.Normalize()`transform = torchvision.transforms.Compose([torchvision.transforms.ToTensor(),

torchvision.transforms.Normalize(mean = [0.5],std = [0.5])])`

transforms.ToTensor()与transforms.Normalize()函数解析简单来说,前者转换输入图片的格式(格式变化见上一个小标题“图像通道表示”),并归一化到

(0,1)后者使用公式

"(x-mean)/std",将每个元素分布到(-1,1)-

构建数据集

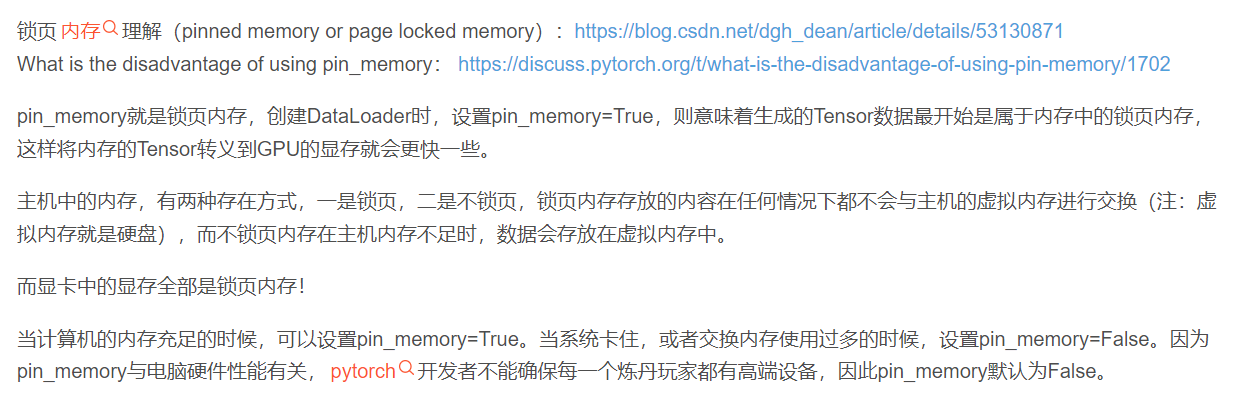

batch_size

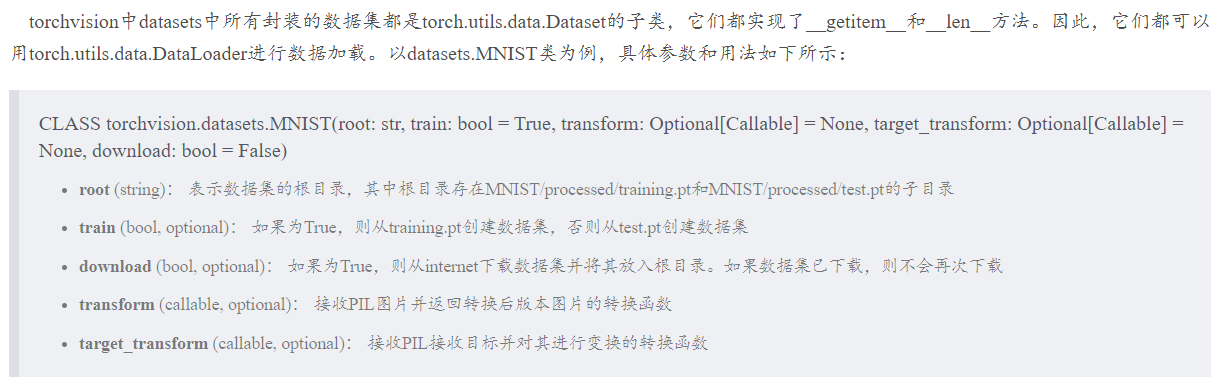

Datasets&Dataloaders

数据增强操作

PyTorch 学习笔记:transforms的二十二个方法(transforms用法非常详细)

建立模型

面向对象编程的方式搭建CNN网络 | PyTorch系列(十三)

PyTorch神经网络中可学习的参数——CNN权重 | PyTorch系列(十五)

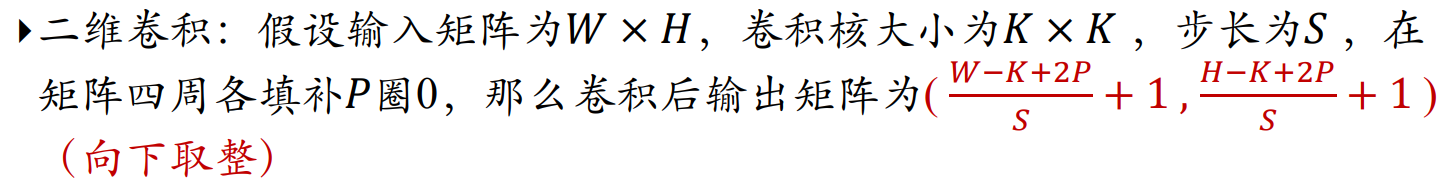

输出特征图的维度

很怪 用的网络不一样 Acc Rate能差1%

还得多研究研究

- 本文链接:https://wan-nan.github.io/2022/05/23/CV%E5%85%A5%E9%97%A8%EF%BC%9AMNIST-%E6%89%8B%E5%86%99%E6%95%B0%E5%AD%97%E4%BD%93%E8%AF%86%E5%88%AB/

- 版权声明:本博客所有文章除特别声明外,均默认采用 许可协议。